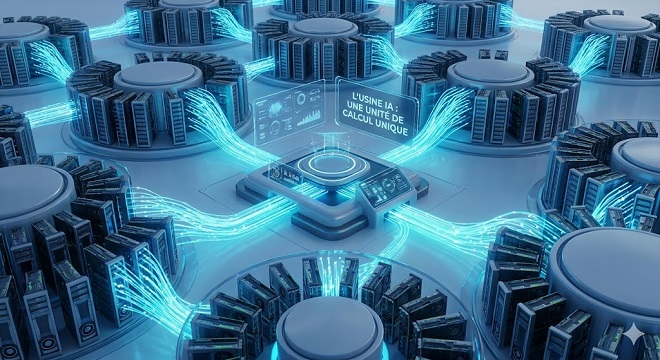

Tunisie-Tribune (L’IA) – Lors de la GTC 2026, Gilad Shainer, figure de proue de la division réseau de Nvidia (un segment pesant désormais 11 milliards de dollars), a détaillé la stratégie du géant de Santa Clara. Pour lui, le réseau n’est plus un simple support, mais l’épine dorsale qui transforme une ferme de serveurs en une véritable « usine IA ».

Le réseau, nouveau cœur battant de l’usine IA

Selon Gilad Shainer, l’unité de calcul n’est plus le processeur isolé (CPU ou GPU), mais l’ensemble du centre de données. Pour que cette « usine » fonctionne comme une entité unique, la connectivité entre les GPU est cruciale. C’est la qualité du réseau qui détermine la puissance réelle de l’infrastructure, marquant la différence entre un stockage de données classique et un supercalculateur IA performant.

L’innovation annuelle : de l’inférence au stockage CMX

Nvidia maintient un rythme effréné avec des lancements technologiques annuels. Cette année, l’accent est mis sur l’infrastructure CMX, une solution de stockage optimisée pour l’inférence. Elle répond à l’explosion des besoins liés au KV Cache (Key-Value Cache) des grands modèles de langage (LLM), tout en maximisant l’efficacité énergétique, un enjeu devenu le principal facteur limitant de l’expansion des centres de données.

Vers la domination de l’optique et du 1,6 Tbit/s

La transition vers le très haut débit est actée. Nvidia déploie désormais des modules de transmission de 1,6 Tbit/s (utilisant deux ports de 800G). L’avenir appartient aux optiques co-packagées (CPO), où le moteur optique est intégré directement dans l’ASIC du commutateur. Cette approche permet :

- Une réduction de la consommation d’énergie (jusqu’à 5 fois moins).

- Une fiabilité accrue (jusqu’à 10 fois plus) en réduisant le nombre de composants et de lasers.

- Une résilience optimisée pour les workloads critiques.

Refroidissement liquide : une étanchéité totale

Face à la montée en puissance thermique, Nvidia généralise le refroidissement par liquide. Contrairement à d’autres standards du marché comme le XPO d’Arista, Nvidia privilégie une intégration native. Ses commutateurs sont conçus pour être 100 % refroidis par liquide, immergeant les circuits et connecteurs pour éviter la multiplication des boucles de refroidissement externes et simplifier l’architecture des racks.

InfiniBand vs Spectrum-X : deux approches pour l’IA

Interrogé sur la rivalité entre les protocoles, Gilad Shainer reste pragmatique :

- InfiniBand : Reste le roi de la latence ultra-faible, idéal pour le calcul scientifique (HPC).

- Spectrum-X (Ethernet) : Conçu pour ceux qui viennent du monde Ethernet, intégrant des technologies InfiniBand pour offrir des performances IA sans gigue, tout en conservant une gestion logicielle familière.L’objectif est d’offrir le choix aux entreprises selon leur expertise historique, tout en garantissant une efficacité maximale pour l’entraînement des modèles.

L’IA-RAN et l’Edge Computing : le rôle stratégique des DPU

L’avenir du réseau s’étend jusqu’aux télécoms avec l’AI-RAN. Nvidia mise sur ses DPU (Data Processing Units) comme le BlueField 4 pour fusionner calcul et réseau à la périphérie (Edge). Cette unité permet aux opérateurs de transformer leurs stations de base en micro-centres de données capables d’exécuter des charges IA complexes, optimisant ainsi la connectivité amont/aval de la 5G et de la future 6G.

« Le photonique va changer la donne pour tout le monde. En intégrant l’optique au commutateur, on élimine le goulot d’étranglement énergétique et on libère la puissance de calcul. » — Gilad Shainer.